연예인과 아동 특정부위 3000여개 합성… 딥페이크 제작해 30달러에 팔았다

강동삼 기자

입력 2022 11 15 18:18

수정 2022 11 15 18:18

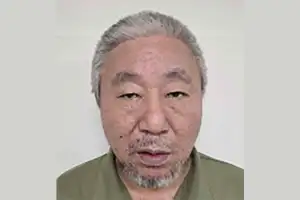

제주경찰청은 딥페이크 영상을 3000여개를 제작해 판매한 혐의(성폭력범죄의 처벌 등에 관한 특례법 위반과 아동·청소년의 성보호에 관한 법률 위반 혐의)로 30대 남성 A씨를 구속해 최근 검찰에 송치했다고 15일 밝혔다.

A씨는 2020년 8월부터 지난달까지 텔레그램 그룹 채팅방을 통해 자신이 만든 아동·청소년과 연예인 딥페이크 영상 3000여 개를 1인당 월 30달러씩 받고 제공한 혐의를 받는다.

딥페이크(deepfake)는 딥러닝(deep learning)과 페이크(fake)의 합성어로 인공 지능(AI) 기술을 활용해 기존 인물의 얼굴이나, 특정 부위를 합성한 영상편집물을 뜻한다. 미국에서 ‘딥페이크’라는 네티즌이 미국 온라인 커뮤니티 레딧에 할리우드 배우의 얼굴과 포르노를 합성한 편집물을 올리면서 시작됐으며 일반인까지 대상이 되면서 사회적 문제가 됐다.

제주 강동삼 기자

ⓒ 트윅, 무단 전재 및 재배포 금지